曾经凭借四足机器人和人型机器人“翻跟头、跳舞”等病毒式视频刷屏的 Unitree(宇树科技),现在开始在实用技能上动真格的了。该公司近日正式开源了 UnifoLM-VLA-0,这是一个视觉-语言-动作(VLA)模型,旨在为机器人植入一个处理通用操纵任务的“具身智能大脑”。简单来说,你的家务活儿,机器人可能很快就能接手了。

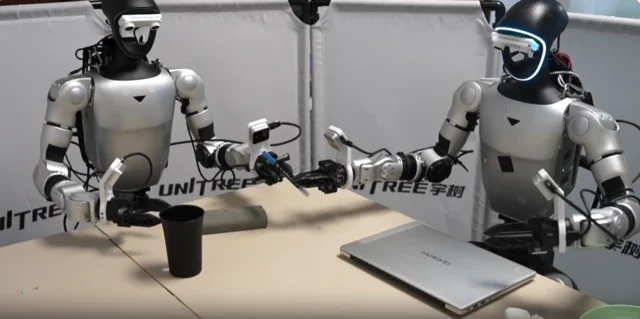

这个新模型让宇树的 G1 人型机器人能够自主执行一系列复杂的任务,其表现远超那些排练好的演示动画。我们说的是徒手拧开药瓶、将网球拍和网球装入包中并拉上拉链,以及有条不紊地整理挂板上的工具。据 Unitree 介绍,该模型通过单一策略即可可靠地处理 12 类复杂的操纵任务,这标志着迈向真正“全能型”机器人的一大步。

这个全新的“具身大脑”构建在 Qwen2.5-VL-7B 之上,后者是阿里巴巴 Qwen 团队开发的一款强大的开源视觉语言模型。Unitree 随后利用真实机器人数据进行了持续预训练,从而赋予了模型物理常识。目前,包括代码和模型权重在内的整个项目已在 GitHub 上面向开发者开放。超链接:UnifoLM-VLA on GitHub

为什么这很重要?

Unitree 的这一举动具有双重深远意义。首先,通过开源高性能的 VLA 模型,该公司极大地降低了研究人员和开发者为垂直领域开发人型机器人应用的门槛。这无疑是对某些竞争对手所青睐的“封闭生态”模式的一次直接挑战。

其次,或许更为关键的是,这种先进的 AI 算法是与极具价格竞争力的硬件配套出现的。Unitree G1 人型机器人的起售价仅为 1.6 万美元,这一价格比许多竞争对手低了一个数量级。虽然功能更先进的进阶版(EDU 版本)价格更高,但基础款的价格已经让学术界和商业研发机构触手可及。将低成本、高性能的人型机器人硬件与免费开源的 AI 脑力相结合,堪称加速整个机器人领域进化的“王炸”组合。机器人管家的时代,似乎离现实又近了一大步,不再仅仅是科幻电影里的桥段。