就在大家觉得 AI 圈的“世界模型”概念已经快被喊烂了的时候,NVIDIA 掏出了一个真正能改变物理世界的狠角色。这就是 DreamZero,一个拥有 140 亿参数的机器人基础模型。它最硬核的能力在于:只需一段简单的文本指令,就能完成从未经过专门训练的任务。NVIDIA 将其定义为“世界动作模型”(World Action Model,简称 WAM),其核心绝活是:在视频像素层面先“梦见”正确的未来画面,然后倒推出机器人所需的电机控制指令,从而将这一“美梦”变为现实。

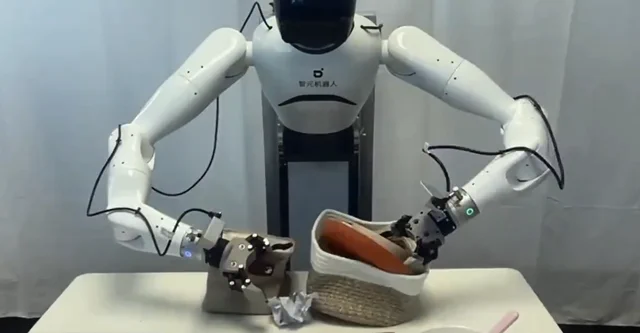

最让人惊掉下巴的是它那恐怖的适应能力。DreamZero 能够将学到的知识迁移到一台完全陌生的机器人身上,且仅需约 55 次演示轨迹——这大约相当于人类遥控操作 30 分钟的数据量。相比以往动辄需要数百小时演示数据的模型,这简直是跨代级的效率飞跃。根据 NVIDIA 的研究数据,在面对新任务和新环境的泛化表现上,DreamZero 的性能达到了此前最顶尖视觉-语言-动作(VLA)模型的两倍以上。从解鞋带到握手,你可以在官方项目网站上看到这台机器人在各种场景下的实战表现。

该项目还提出了两个足以颠覆机器人训练传统认知的核心观点:首先,对于 WAM 来说,数据的多样性远比对同一个任务进行枯燥的重复训练重要得多;其次,长期困扰业界的“跨本体”(cross-embodiment)知识迁移难题(即如何让不同形态的机器人互相学习),最好的解药其实是“像素”。事实证明,视频才是通用语言,它能让技能在不同机器人之间、甚至从人到机器人之间实现高效迁移。目前,该模型及其权重已通过 GitHub 开源,这意味着整个机器人社区都能在这个全新的地基上添砖加瓦。

为什么这很重要?

DreamZero 的出现标志着机器人学习范式的根本性转变。我们不再需要费尽心机地为每一个细碎任务编写程序——那种做法既低效又脆弱——整个行业正在转向能够即时学习和适应的通用型模型。通过视频学习世界的物理规律,WAM 能够针对从未见过的任务生成行为,比如解开鞋带,即便训练数据里根本没有这项技能。

研究人员谦虚地将此阶段比作机器人领域的“GPT-2 时代”——它虽然还没达到“GPT-3 级别”的绝对可靠,但已经迈出了极具威力的基础性一步。通过让机器人从包括人类视频在内的多元数据中汲取养分,并在几分钟内适配新硬件,NVIDIA 正在大幅降低复杂机器人应用的部署门槛。这件事的本质不在于教会机器人做某一份特定的“工作”,而是赋予了它学习任何工作的能力。