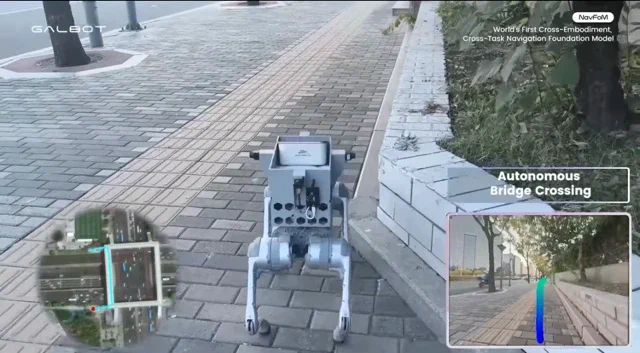

来自上海交通大学与**商汤科技(SenseTime Research)**的研究团队最近发布了一段重磅视频,展示了他们最新的科研成果——NavFm。官方称其为“全球首个跨形态、跨任务的机器人导航大模型”。通俗点说,他们正在为机器人打造一个“通用大脑”,理论上,无论给这个大脑套上什么样的机器人外壳,它都能在不撞墙、不迷路的情况下,顺利从 A 点到达 B 点。在演示视频中,一只“平平无奇”的机器狗成功通过了这场城市障碍挑战赛。

这只四足机器人表现得相当老练:它能从容地在密集的行人中闪转腾挪;即便面对复杂的视觉干扰,也能死死“锁住”目标行人进行跟随;甚至还能独立完成多阶段的递送任务。在接收到指令后,它会自主规划路线,跨越天桥、穿过人行道、爬上台阶,最终抵达目的地。这种对环境的敏锐感知和基于任务的路径规划能力,显然比传统的遥控操作或预设路线高出了一个维度。当然,在演示视频的“理想环境”中漫步是一回事,去应对混乱的真实街头又是另一回事——毕竟,不少自动驾驶配送车已经在现实世界的“修罗场”里交过昂贵的学费了。 中国无人驾驶送货车无视障碍

为什么这项技术至关重要?

这背后的关键词是“大模型(Foundation Model)”和“跨形态(Cross-embodiment)”。以往,开发者必须苦哈哈地为每一款新机器人编写特定的导航逻辑,而大模型提供的是一种“通用智能”。打个比方,这就像是不用再为每一款车单独设计发动机,而是发明了一套通用的“自动驾驶系统”,装在什么车上都能开。

如果 NavFm 的实际表现能达到其宣传的高度,那么引导这只机器狗的核心模型,经过极少量的微调,就能无缝迁移到轮式无人机甚至人形机器人身上。这将极大缩短机器人的开发周期,也是通向“通用机器人”时代的关键一步——让机器人学会像人类一样,无论换到什么身体、处于什么环境,都能即插即用地适应和行动。