设想一下 2035 年的场景:你正站在一座巨大的现代化工厂中央,眼前是 300 台有条不紊忙碌着的人形机器人。场面极其壮观,但一个现实的尴尬也接踵而至——为了指挥这支“钢铁大军”,你的办公桌上堆着 300 个对应的遥控器。当你试图把这些遥控器拼成一套“机甲驾驶舱”时,HR 已经因为安全隐患第三次找你谈话了。

如何管理大规模机器人集群?这听起来不够“赛博朋克”,但却是通往自动化未来最难以逾越、也最乏味的深水区难题。如果,你只需要“心念一动”,这群机器人就能悉听尊便呢?

这并非科幻惊悚片的开场,而是一个名为 Kinexus 的全新开源项目试图攻克的堡垒。在 Neuralink 等侵入式脑机接口(BCI)因“开颅”风险让人望而却步时,Kinexus 选择了一条更亲民的路径:利用非侵入式的 EEG(脑电图)头显,将人类的思维和语音指令实时翻译成机器人集群的动作。它不求手术植入,而是致力于在人类大脑与机器人劳动力之间,搭建一座可扩展的、务实的沟通桥梁。

机器人控制的“规模化危机”

随着工厂和仓库纷纷引入人形机器人,一个棘手的运营挑战浮出水面:传统的“一人一机”操控模式根本无法应对规模化需求。现有的控制手段要么依赖复杂的软件界面,要么使用笨重的“示教器”(teach pendants),每一台机器人都需要单独编程。这种低效的交互方式成了木桶上最短的那块板,限制了机器人本应带来的生产力爆发。管理几台机器人是技术活,管理几百台则是后勤噩梦。

正因如此,一个中心化、直观的指挥中心变得至关重要。工业界急需一个针对物理资产的“控制平面”(Control Plane),让一名人类主管就能行云流水地调度整支舰队。Kinexus 认为,最直观的用户界面其实就长在我们肩膀上:大脑。

Kinexus:大脑即是仪表盘

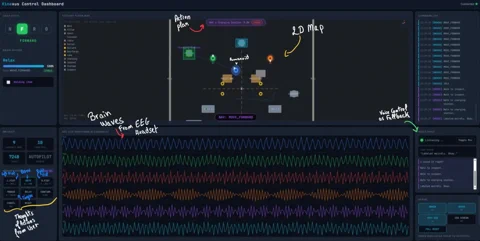

从底层逻辑来看,Kinexus 是一个充当实时“翻译官”的控制仪表盘。该系统由 AI 开发者 Mourad Ouazmour 主导,主要使用 Python 编写,旨在成为工厂自动化的“中枢神经系统”。它能可视化来自市售 EEG 头显的脑电信号,将其转化为具体的指令,并对整个工厂环境进行建模,实现全局态势感知。

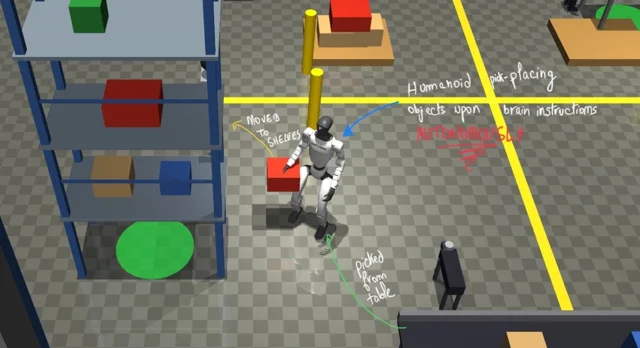

其控制逻辑非常直接且具象。根据开发者的演示,用户只需握紧右手拳头,机器人就会右转;双拳紧握,机器人则向前行进;甚至通过顶一下舌头就能切换控制模式。仪表盘实时展示了这一过程:

- EEG 实时波形(EEG Live Waveform): 实时流式传输大脑的电活动,并细分为不同的频道。

- 映射面板(Methods Panel): 这是系统的“翻译引擎”,将特定的心理暗示(如想象握拳)精准映射到机器人的动作指令(如“MOVE_LEFT”或“MOVE_FORWARD”)。

- 工厂平面图(Factory Floor Map): 一个 2D 示意图,标示了每台人形机器人的位置、状态以及当前的行动计划。

- 语音兜底方案(Voice Fallback): 对于更复杂的自主任务,系统不再依赖直接的“读心术”。用户只需说一句:“从传送带上拿走那个箱子,放在 2 号托盘上”,被指定的机器人就会自主导航并完成整套动作。

科幻雄心与开源现实的碰撞

虽然利用非侵入式 EEG 控制机器人并非新鲜事,但将其应用于“集群管理”却极具前瞻性。以往的 EEG 研究大多集中在残障辅助或单体控制上,简单任务的准确率通常在 70% 到 90% 之间波动。Kinexus 的野心在于将这项技术从实验室搬到喧闹的工厂车间。

将 Kinexus 放在 GitHub 上完全开源,是该项目最具杀伤力的特质。它打破了机器人巨头的技术围墙,让这种先进的控制范式变得触手可及。它不是某家公司的闭环产品,而是一个任何人都能尝试、改进或与 OpenBCI 等开源硬件集成的工具箱。这种“众人拾柴”的模式,有助于开发者共同攻克 EEG 控制中固有的挑战,比如信号噪声干扰和因人而异的校准需求。

当然,从一个 GitHub 仓库进化到真正 mind-controlled(脑控)的工厂,路还很长。非侵入式 EEG 的分辨率远低于植入式方案,要达到工业生产所需的 99.9% 以上的可靠性,依然是一座大山。但 Kinexus 卖的不是成品,而是一个大胆的愿景。它向我们展示了一个未来:在自动化环境中,人类的监管不再是疯狂地按电钮,而是一种专注的、战略性的意志输出。目前来看,它为我们提供了一个迷人的侧影——管理数百台机器人,或许真的只需要“动动脑子”。