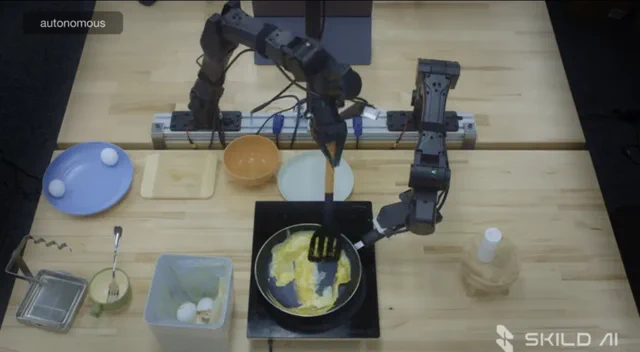

在通往通用机器人这条宏大而又时常笨拙的马拉松赛道上,整个行业屡屡在同一个“老大难”问题上“栽跟头”:数据。当语言模型可以把整个互联网当成文本的“饕餮盛宴”大快朵颐时,机器人领域却只能靠缓慢、昂贵且“营养不良”的远程操控来“口对口”喂养自己的“孩子们”。但现在,一家名为 Skild AI 的初创公司决定不再“一口一口喂”,而是直接把“菜单”摆在机器人面前。他们最新的例证?一个机器人手臂在观看人类视频学习技能后,能够轻松搞定一盘香喷喷的炒鸡蛋。

这可不只是一项绝活儿。它更是对物理 AI 核心问题——数据瓶颈——的“釜底抽薪”。目前主流的机器人训练方法,涉及人类操作员远程“操纵”机器,以收集任务所需的精确运动控制数据。正如 Skild AI 所指出的,这种策略却被两大致命缺陷死死“套牢”:首先,它缺乏多样性,因为大多数数据都是在严苛的实验室环境中收集的;其次,在数学上,它根本无法实现规模化,达到构建真正基础模型所需的水平。你根本不可能雇佣足够多的人类 24/7 操控机器人,来生成所需的数万亿个数据点。

YouTube 到机器人的“数据管线”

Skild AI 没有试图建造一个庞大的数据农场,而是盯上了早已存在的那个“数据金矿”:互联网。该公司的核心洞察是,人类已经以 YouTube 教程、TikTok 妙招和无数其他教学视频的形式,为机器人学创建了一个“互联网规模”的数据集。这个藏在眼皮底下的解决方案,就是观察学习——人类学习的同款模式。我们不会通过计算流体力学来学习如何倒水;我们只是看着别人做,剩下的一切自然水到渠成。

Skild AI 正在教导其模型以同样的方式学习。通过观看人类执行任务的视频,AI 学习意图和行动序列,有效地将视觉演示转化为机器人指令。

当然,事情没那么简单。给机器人看一段戈登·拉姆齐制作威灵顿牛排的视频,然后就指望它能端出一顿米其林星级大餐,这纯属天方夜谭。主要的技术挑战是行业内所称的“具身鸿沟”(Embodiment Gap)。人手有 27 个自由度;而一个双指夹持器则没有。将人类厨师流畅的动作映射到多轴机械臂僵硬的关节上,这本身就是一个堪称“工程奇迹”的翻译难题。

“全具身”学习与 Skild 大脑

这正是 Skild AI 宣称其“独门秘籍”所在。该公司开发了一个他们称之为“全具身”(omni-bodied)的基础模型,并将其命名为 Skild Brain。这款 AI 被设计成硬件无关,能够控制各种机器人形态——从轮式人形机器人到固定式机械臂——而不会对任何单一形态过度专业化。该模型在海量人类视频和基于物理的模拟的“营养大餐”中进行预训练,使其能够建立对物体应如何操纵的通用理解。

该公司表示:“通过经验学习,而非预编程,是机器人领域发生的质的飞跃。”他们强调,通过利用 NVIDIA 的模拟和 AI 基础设施,使其能够在“弹指之间”获取“千年道行”。

这种方法使得机器人可以通过视频学习新技能,且仅需不到一小时的机器人特定数据进行微调。其结果是一个能够泛化到不同任务和环境的系统,正如他们在演示中展示的机器人装载洗碗机、浇花和拉窗帘。

机器人革命的深远影响

如果 Skild AI 的方法能像其宣称的那样具有可扩展性和有效性,其影响将是巨大的。它将彻底颠覆机器人训练的经济学。对庞大而昂贵的远程操控农场的需求,可能会被能够从不断增长的、公开可用的人类活动库中学习的强大模型所取代。这可能会显著加速机器人在非结构化环境的部署,例如家庭、餐馆和建筑工地——这些传统上自动化一直面临困难的场所。

业界正在密切关注。人形机器人和通用机器人领域的竞争对手,都在对解决数据问题进行“孤注一掷”的豪赌,无论是通过远程操控、模拟还是人类视频。

目前,Skild AI 已经带来了一场引人入胜,坦率地说,连屏幕前的我都想尝尝的“美味”演示。当世界其他地方正忙着为人类创造可供观看的内容时,Skild 正在悄无声息地将这些内容,转化为未来机器人助手的“教科书”。“自学成才”的机器人大厨时代,或许真的近在眼前了。