机器人行业藏着一个不为人知的“小秘密”:教会机器人做任何有用的事情,都慢如蜗牛,耗资巨大。多年来,主流观点一直是通过视觉-语言-动作模型(VLAs)强行“喂养”智能,这需要人类花费数万小时,一丝不苟地“提线木偶”般操纵机器人完成每一项可想而知的任务。这简直是史诗级的数据瓶颈。

如今,机器人公司 1X 提出了一种近乎“异端邪说”的解决方案。他们针对 NEO 类人机器人的新方法巧妙得令人难以置信:停止那些费时费力的“填鸭式教学”,直接让机器人通过观看浩瀚、混乱却又充满教益的人类行为图书馆——也就是互联网——来学习。这不仅仅是一次升级;它是机器人获取技能方式的根本性转变。

昨日的“数据饕餮巨兽”

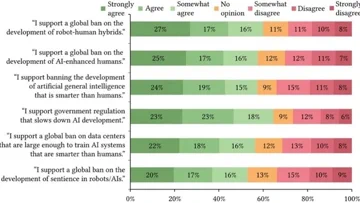

要理解 1X 正在实现的飞跃,你必须先了解现状。大多数现代机器人基础模型,从 Figure 的 Helix 到 Nvidia 的 GR00T,都是VLAs。这些模型虽然强大,但它们对高质量、机器人专属的演示数据贪得无厌。这意味着,需要雇佣人类远程操作机器人数千小时,来收集诸如拿起杯子或叠毛巾之类的示例。

这种方法是创建真正通用型机器人的主要障碍。它成本高昂,难以规模化,而且由此产生的模型可能脆弱不堪,一旦遇到从未见过的物体或环境便会束手无策。这就像教孩子做饭,只允许他看你在自家厨房里操作,而不是让他把所有美食节目都刷个遍,开眼界、学百家。

梦想着……做家务?

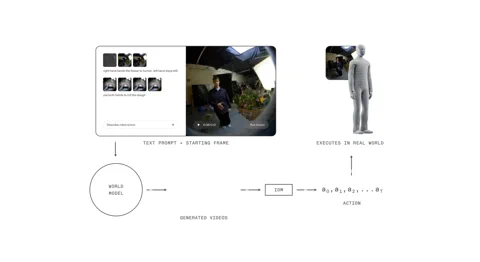

1X 世界模型(1XWM) 彻底抛弃了那套老掉牙的剧本。它不再直接将语言映射到动作,而是利用文本条件视频生成来推断该做什么。它拥有一个“双核大脑”,有效地让机器人在行动前能够“想象”未来。

首先是 世界模型(WM),一个拥有140亿参数的生成式视频模型,充当系统的“想象力中枢”。你给 NEO 一个文本提示——“把这个橘子装进午餐盒”——WM 会根据当前场景,构想出一个简短、合理的任务完成视频。

接着,是 逆动力学模型(IDM),这个机器中的“务实派”会分析这个“梦想”。它将生成的像素转化为具体的电机指令序列,弥合了视觉上的“是什么”与物理上的“如何做”之间的鸿沟。这一过程通过多阶段训练策略得以夯实:模型首先从网络规模的视频开始学习,然后在中期训练阶段利用900小时的第一人称视角人类视频,获得主体视角,最后再用仅仅70小时的 NEO 专属数据进行微调,以适应自己的身体。

他们训练管线中的一个巧妙“骚操作”是“标题上采样”(caption upsampling)。由于许多视频数据集的描述过于简洁,1X 使用 VLM 来生成更丰富、更详细的标题。这提供了更清晰的条件约束,提高了模型遵循复杂指令的能力,这种技术在 OpenAI 的 DALL-E 3 等图像模型中也展现出类似的优势。

类人机器人的“硬核”优势

这种“视频优先”的方法,其核心关键,且或许显而易见,在于硬件本身:机器人被塑造成人类的形状。1XWM 通过观看无数小时的人类与世界互动的视频,发展出对物理先验——重力、动量、摩擦、物体可供性——深刻而隐性的理解,这些理解可以直接迁移,因为 NEO 的身体运动方式从根本上就是类人化的。

正如 1X 所言,硬件在“AI堆栈中拥有‘一等公民’的地位”。NEO 与人类在运动学和动力学上的相似性意味着模型所学到的先验知识通常保持有效。模型能可视化什么,NEO 就常常能真正做到什么。这种硬件与软件的紧密集成,弥合了模拟与现实之间那道险象环生的鸿沟。

从理论到现实(伴随着一些小磕绊)

成果令人信服。1XWM 允许 NEO 泛化到它从未接受过直接训练的任务和物体上。宣传视频展示了它熨烫衬衫、浇花,甚至操作马桶座圈——一个它此前没有任何示例的任务。这表明双臂协调和复杂物体交互的知识正在成功地从人类视频数据中迁移过来。

但这可不是魔法。该系统有其局限性。生成的“预演”可能“过于乐观”,其单目预训练可能导致薄弱的3D基础,使得真实的机器人即使在生成的视频看起来完美无缺时,也可能对目标不足或过冲。在诸如倒麦片或画笑脸等灵巧操作任务上的成功率仍然充满挑战。

然而,1X 找到了一种提升性能的“灵丹妙药”:测试时计算。对于“抽取纸巾”任务,成功率从单次视频生成时的30%跃升至允许系统生成八种不同的可能未来并选择最佳方案时的45%。虽然目前这种选择仍需手动干预,但这预示着未来 VLM 评估器可以自动化这一过程,显著提高可靠性。

自我学习的“飞轮效应”

1XWM 不仅仅是一次增量更新;它是一种潜在的范式转变,有望彻底打破数据瓶颈。它为自我提升创造了一个飞轮。通过能够以非零成功率尝试广泛的任务,NEO 现在可以生成自己的数据。每一次行动,无论是成功还是失败,都成为新的训练示例,可以反馈到模型中以优化其策略。机器人开始自我学习。

当然,巨大的障碍依然存在。WM 目前需要11秒来生成一个5秒的计划,IDM 还需要一秒来提取动作。在动态、真实的复杂环境中,这种延迟简直是“度日如年”,对于反应式任务或精细、接触密集型操作来说,根本行不通。

尽管如此,通过正面攻克数据问题,1X 或许已经一脚踢开了通往未来的大门——一个机器人不再依赖我们繁琐指令,而是从我们集体记录的经验中学习的未来。这个未来,正以每部网络视频为燃料,加速前进。